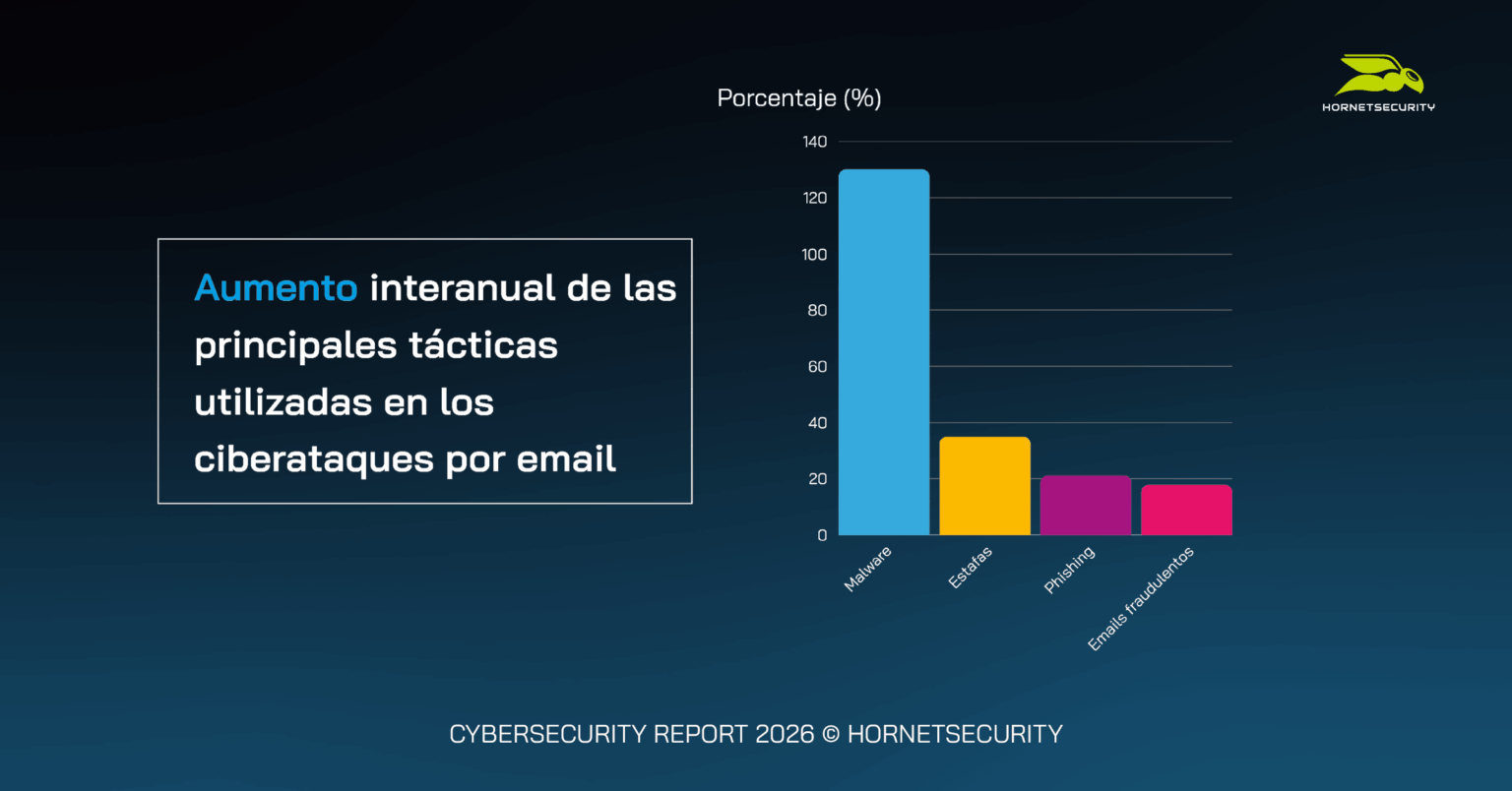

En un entorno donde las amenazas digitales avanzan a pasos agigantados, el último Informe de Ciberseguridad del Hornetsecurity Security Lab ha puesto de manifiesto un inquietante aumento en los ataques de malware a través del correo electrónico, que se han incrementado en un 131% en comparación con el año anterior. Junto a este fenómeno, también ha habido un marcado crecimiento en las estafas y el phishing, con incrementos del 35% y 21%, respectivamente. Este escenario ha impulsado al 68% de las organizaciones a apostar por soluciones de protección basadas en inteligencia artificial (IA).

El estudio, que examinó aproximadamente 72.000 millones de correos electrónicos, confirma que el correo electrónico sigue siendo un punto de acceso privilegiado para los ciberdelincuentes. Gracias a la IA generativa, los atacantes ahora pueden crear contenidos fraudulentos con mayor efectividad, lo que ha llevado al 77% de los responsables de seguridad de la información (CISOs) a categorizar el phishing impulsado por la IA como una amenaza notablemente creciente.

El informe también destaca que un 61% de los CISOs identifica un aumento en el riesgo de ataques de ransomware relacionados con el mal uso de la IA. Sus inquietudes incluyen la generación de documentos y credenciales fraudulentas mediante el uso de fraudes de identidad sintética, la clonación de voz, los vídeos deepfake y la manipulación de datos en sistemas de IA internos. Además, el uso de herramientas de IA por parte de empleados se perfila como un riesgo creciente.

Sin embargo, el grado de comprensión de estos peligros varía significativamente entre los ejecutivos. Algunos muestran una gran conciencia sobre las amenazas que la IA representa, mientras que otros no comprenden plenamente su papel en los ataques. Esta disparidad indica que, aunque hay un reconocimiento general de los riesgos, la preparación y respuesta ante estos desafíos sigue siendo desigual entre las organizaciones.

Daniel Hofmann, CEO de Hornetsecurity, subrayó la necesidad apremiante de que los esfuerzos de concienciación en seguridad evolucionen al ritmo del avance de la IA. «Con la proliferación de la desinformación impulsada por la inteligencia artificial y la extorsión mediante deepfakes, es vital establecer una cultura de seguridad que esté preparada y consciente de las implicaciones de la IA, un objetivo clave para 2026», afirmó Hofmann.